Автор: NO.

|

|

Такс…

Ну во первых NO – юродивый, он не рагуль и не картавый, но и настоящим русским его не назовешь, как например Дмитрия Надёжина, а в Ёшкароле живут только те кого на СВО можно заюзать в качестве героя, никак больше. Почему NO ещё не на СВО непонятно.

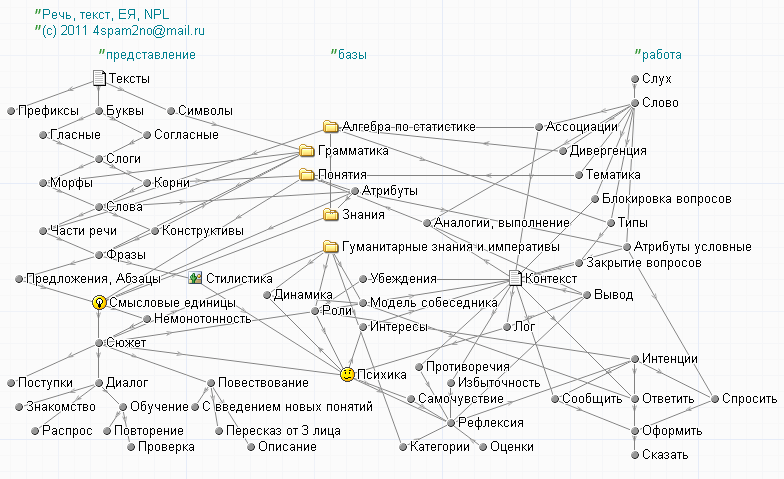

Но взглянем на эту модель NLP критически. На первый взгляд, это похоже на попытку объединить лингвистику, психологию и математику в единую концептуальную схему. Причем та… на коленке, для разговора подд пивко и водочку с местными алконафрами с Ёшкаролы. Амбициозно? Да. Работает ли на практике? Хм, давайте разберёмся.

1. Структура: дерево или каша?

Автор явно стремился к строгой категоризации, но получился некий франкенштейн из понятий. Например, в разделе "представление" валяются вместе символы, слова, морфы и конструкции, но неясно, как это взаимосвязано в вычислительном смысле.

А вот в разделе "работа" рядом соседствуют "атрибуты условные", "вывод" и "лог", что выглядит так, будто кто-то не выдержал и просто накидал все термины, которые приходили в голову.

Если бы это была база данных, её бы взорвали уже на первом SELECT *. Помнится тут был рагуль "это- ИА" который делал свою базу данных, но облажался, не потянул, он бы ту сказал пару ласковых коллеге кодеру неудачнику NO, если его не забрали на СВО.

Далее, два. Грамматика vs. семантика: где оно понимает смысл?

Есть узлы "грамматика" и "смысловые единицы", но нет чёткого моста между ними. Как из грамматики извлекается смысл? Где семантические векторы? Где дистрибутивные представления?

Выглядит так, будто модель предлагает понять смысл предложения, просто хорошенько на него посмотрев.

3. Когнитивные аспекты: серьёзно, психика?

Психология, ассоциации, самочувствие, убеждения — отлично, но как это обрабатывается машиной?

Где формальные модели эмоций?

Как намерения интерпретируются с точки зрения нейросетей?

Почему "категории" находятся отдельно от "контекста", хотя именно они помогают его формировать?

Такое ощущение, что в какой-то момент автор просто добавил всё, что может повлиять на понимание текста, не задумываясь о том, как это можно вычислять.

Это как попытка научить ИИ понимать сарказм, просто добавив узел "сарказм". Отличный план, но нет.

4. Где математика?

Есть узел "алгебра-статистика", но он выглядит сиротливо и не связан ни с чем важным.

Где векторные пространства слов?

Где вероятностные модели?

Где внимание (attention)?

Это как сказать: "У нас есть нейросеть, а ещё у нас есть высшая математика", но не объяснить, как одно связано с другим.

5. Вывод: классическая ошибка универсальной модели

Попытка учесть всё сразу без понятной иерархии приводит к логическому перегреву. В итоге модель:

В общем, Выглядит умно. Но не объясняет, как её реализовать, не показывает, какие из этих элементов реально работают в NLP, а пытается прыгнуть выше головы, таща за собой психологию, философию и, возможно, шаманизм.

Если бы это была архитектура реального AI-проекта, инженеры сбежали бы в первую неделю.

Но что делать? Собирать на мусорке детальки и ножики мастерить?

Чтобы эта модель стала полезной, нужно:

Ясно разделить уровни обработки текста: морфология → синтаксис → семантика → прагматика.

Добавить связи с реальными методами NLP: word embeddings, transformers, probabilistic models.

Разделить когнитивные факторы на вычислимые (например, контекст через attention-механизмы) и нефункциональные (типа "самочувствия").

В текущем виде это не модель NLP, а набор идей. Хороший, но бессистемный.

Итог: если это попытка объяснить, как человек понимает текст, то это интересная карта размышлений.

Если это претензия на архитектуру NLP-модели, то у нас тут перед глазами Список Несбывшихся Надежд Искусственного Интеллекта , пардон.